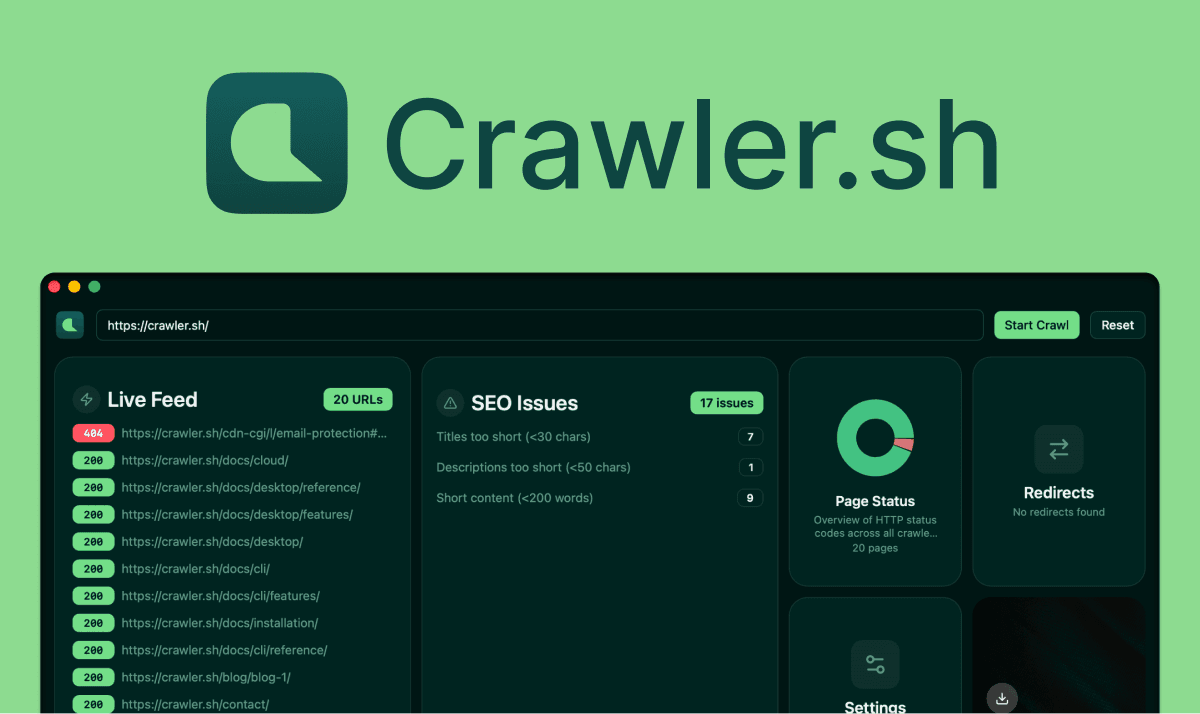

crawler.sh

暂无定价专为开发者与 SEO 专家打造的高速本地爬虫,支持秒级全站抓取、内容提取及多格式数据导出。

关于此工具

工具截图

核心功能(4)

极速全站抓取

支持自定义并发数、抓取深度及请求延迟。即使面对包含数千页面的复杂站点,也能在短时间内完成深度遍历。

16 项自动化 SEO 审计

自动检测元数据异常、Noindex 指令、死链及 URL 长度等 16 类问题,并可将结果导出为 CSV 或文本报告。

智能内容提取

自动识别页面主体,将其转换为包含字数、作者和摘要的纯净 Markdown 文档,极大简化了内容归档流程。

多端协同与灵活导出

提供强大的 CLI 工具与直观的桌面端应用,支持 NDJSON、JSON、CSV、Sitemap XML 等多种工业标准格式导出。

应用场景(3)

技术 SEO 审计

在网站上线前或维护期运行全量检查,快速发现并修复影响搜索排名的技术缺陷。

内容迁移与 AI 数据集准备

从现有网站批量提取结构化的 Markdown 内容,用于网站改版备份、内容归档或 AI 模型的语料预处理。

自动生成 Sitemap

基于实时爬取结果生成 W3C 兼容的站点地图,无需手动维护,确保搜索引擎始终能够获取最新的页面索引。