Ollama

免费 + $20/月 起让本地运行与部署开源大模型变得前所未有的简单,兼顾隐私与性能。

关于此工具

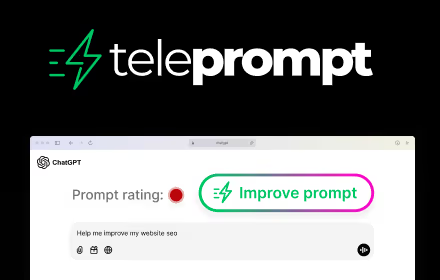

工具截图

核心功能(3)

极简的一键部署

无需复杂的配置环境,通过简单的命令行指令即可快速安装并运行主流开源大模型。

云端与本地无缝扩展

支持从本地起步并按需扩展至云端,享受更快的推理速度与实时联网信息获取能力。

严苛的数据隐私保护

承诺用户数据绝不用于模型训练,并支持在断网环境下完全离线运行,确保核心业务安全。

应用场景(3)

用户评价

基于 10 条评价

发表您的评价

需要登录后才能发表评论,

Ollama is the choice for our users wanting local graphs, works best with 32b param models.

Easy to use, like Docker for AI.

Ollama is the best way to run LLMs locally and the easiest way to test, build, and deploy new models. It has opened my eyes to the world of LLMs, a fantastic product.

Cheaper than GPT & easier to get structured output.

正在用Ollama本地测试和运行LLM——迭代更快、零延迟、完全掌控。就像自己开了个AI实验室,还不用烧GPU的钱

免费玩AI的最佳选择,数据本地跑,安全又放心~